[ad_1]

[ad_2]

Tweedy Lumber dan Hardware dinobatkan sebagai Anggota Terbaik Tahun 2025

Hardware Dan SoftWare Komputer

Mengenal prangkat-perangkat lunak serta keras dalam teknology dunai komputer

[ad_1]

[ad_2]

Tweedy Lumber dan Hardware dinobatkan sebagai Anggota Terbaik Tahun 2025

[ad_1]

The artificial intelligence landscape is witnessing a profound shift, driven not only by advancements in algorithms but also by a quiet revolution in hardware. At its heart is the RISC-V (Reduced Instruction Set Computer â Five) architecture, an open-standard Instruction Set Architecture (ISA) that is rapidly emerging as a transformative alternative for AI hardware innovation. As of November 2025, RISC-V is no longer a nascent concept but a formidable force, democratizing chip design, fostering unprecedented customization, and driving cost efficiencies in the burgeoning AI domain. Its immediate significance lies in its ability to challenge the long-standing dominance of proprietary architectures like Arm and x86, thereby unlocking new avenues for innovation and accelerating the pace of AI development across the globe.

This open-source paradigm is significantly lowering the barrier to entry for AI chip development, enabling a diverse ecosystem of startups, research institutions, and established tech giants to design highly specialized and efficient AI accelerators. By eliminating the expensive licensing fees associated with proprietary ISAs, RISC-V empowers a broader array of players to contribute to the rapidly evolving field of AI, fostering a more inclusive and competitive environment. The ability to tailor and extend the instruction set to specific AI applications is proving critical for optimizing performance, power, and area (PPA) across a spectrum of AI workloads, from energy-efficient edge computing to high-performance data centers.

RISC-V’s fundamental design philosophy, emphasizing simplicity, modularity, and extensibility, makes it exceptionally well-suited for the dynamic demands of AI hardware.

A cornerstone of RISC-V’s appeal for AI is its customizability and extensibility. Unlike rigid proprietary ISAs, RISC-V allows developers to create custom instructions that precisely accelerate domain-specific AI workloads, such as fused multiply-add (FMA) operations, custom tensor cores for sparse models, quantization, or tensor fusion. This flexibility facilitates the tight integration of specialized hardware accelerators, including Neural Processing Units (NPUs) and General Matrix Multiply (GEMM) accelerators, directly with the RISC-V core. This hardware-software co-optimization is crucial for enhancing efficiency in tasks like image signal processing and neural network inference, leading to highly specialized and efficient AI accelerators.

The RISC-V Vector Extension (RVV) is another critical component for AI acceleration, offering Single Instruction, Multiple Data (SIMD)-style parallelism with superior flexibility. Its vector-length agnostic (VLA) model allows the same program to run efficiently on hardware with varying vector register lengths (e.g., 128-bit to 16 kilobits) without recompilation, ensuring scalability from low-power embedded systems to high-performance computing (HPC) environments. RVV natively supports various data types essential for AI, including 8-bit, 16-bit, 32-bit, and 64-bit integers, as well as single and double-precision floating points. Efforts are also underway to fast-track support for bfloat16 (BF16) and 8-bit floating-point (FP8) data types, which are vital for enhancing the efficiency of AI training and inference. Benchmarking suggests that RVV can achieve 20-30% better utilization in certain convolutional operations compared to ARM’s Scalable Vector Extension (SVE), attributed to its flexible vector grouping and length-agnostic programming.

Modularity is intrinsic to RISC-V, starting with a fundamental base ISA (RV32I or RV64I) that can be selectively expanded with optional standard extensions (e.g., M for integer multiply/divide, V for vector processing). This “lego-brick” approach enables chip designers to include only the necessary features, reducing complexity, silicon area, and power consumption, making it ideal for heterogeneous System-on-Chip (SoC) designs. Furthermore, RISC-V AI accelerators are engineered for power efficiency, making them particularly well-suited for energy-constrained environments like edge computing and IoT devices. Some analyses indicate RISC-V can offer approximately a 3x advantage in computational performance per watt compared to ARM and x86 architectures in specific AI contexts due to its streamlined instruction set and customizable nature. While high-end RISC-V designs are still catching up to the best ARM offers, the performance gap is narrowing, with near parity projected by the end of 2026.

Initial reactions from the AI research community and industry experts as of November 2025 are largely optimistic. Industry reports project substantial growth for RISC-V, with Semico Research forecasting a staggering 73.6% annual growth in chips incorporating RISC-V technology, anticipating 25 billion AI chips by 2027 and generating $291 billion in revenue. Major players like Google (NASDAQ: GOOGL), NVIDIA (NASDAQ: NVDA), and Samsung (KRX: 005930) are actively embracing RISC-V for various applications, from controlling GPUs to developing next-generation AI chips. The maturation of the RISC-V ecosystem, bolstered by initiatives like the RVA23 application profile and the RISC-V Software Ecosystem (RISE), is also instilling confidence.

The emergence of RISC-V is fundamentally altering the competitive landscape for AI companies, tech giants, and startups, creating new opportunities and strategic advantages.

AI startups and smaller players are among the biggest beneficiaries. The royalty-free nature of RISC-V significantly lowers the barrier to entry for chip design, enabling agile startups to rapidly innovate and develop highly specialized AI solutions without the burden of expensive licensing fees. This fosters greater control over intellectual property and allows for bespoke implementations tailored to unique AI workloads. Companies like ChipAgents, an AI startup focused on semiconductor design and verification, recently secured a $21 million Series A round, highlighting investor confidence in this new paradigm.

Tech giants are also strategically embracing RISC-V to gain greater control over their hardware infrastructure, reduce reliance on third-party licenses, and optimize chips for specific AI workloads. Google (NASDAQ: GOOGL) has integrated RISC-V into its Coral NPU for edge AI, while NVIDIA (NASDAQ: NVDA) utilizes RISC-V cores extensively within its GPUs for control tasks and has announced CUDA support for RISC-V, enabling it as a main processor in AI systems. Samsung (KRX: 005930) is developing next-generation AI chips based on RISC-V, including the Mach 1 AI inference chip, to achieve greater technological independence. Other major players like Broadcom (NASDAQ: AVGO), Meta (NASDAQ: META), MediaTek (TPE: 2454), Qualcomm (NASDAQ: QCOM), and Renesas (TYO: 6723) are actively validating RISC-V’s utility across various semiconductor applications. Qualcomm, a leader in mobile, IoT, and automotive, is particularly well-positioned in the Edge AI semiconductor market, leveraging RISC-V for power-efficient, cost-effective inference at scale.

The competitive implications for established players like Arm (NASDAQ: ARM) and Intel (NASDAQ: INTC) are substantial. RISC-V’s open and customizable nature directly challenges the proprietary models that have long dominated the market. This competition is forcing incumbents to innovate faster and could disrupt existing product roadmaps. The ability for companies to “own the design” with RISC-V is a key advantage, particularly in industries like automotive where control over the entire stack is highly valued. The growing maturity of the RISC-V ecosystem, coupled with increased availability of development tools and strong community support, is attracting significant investment, further intensifying this competitive pressure.

RISC-V is poised to disrupt existing products and services across several domains. In Edge AI devices, its low-power and extensible nature is crucial for enabling ultra-low-power, always-on AI in smartphones, IoT devices, and wearables, potentially making older, less efficient hardware obsolete faster. For data centers and cloud AI, RISC-V is increasingly adopted for higher-end applications, with the RVA23 profile ensuring software portability for high-performance application processors, leading to more energy-efficient and scalable cloud computing solutions. The automotive industry is experiencing explosive growth with RISC-V, driven by the demand for low-cost, highly reliable, and customizable solutions for autonomous driving, ADAS, and in-vehicle infotainment.

Strategically, RISC-V’s market positioning is strengthening due to its global standardization, exemplified by RISC-V International’s approval as an ISO/IEC JTC1 PAS Submitter in November 2025. This move towards global standardization, coupled with an increasingly mature ecosystem, solidifies its trajectory from an academic curiosity to an industrial powerhouse. The cost-effectiveness and reduced vendor lock-in provide strategic independence, a crucial advantage amidst geopolitical shifts and export restrictions. Industry analysts project the global RISC-V CPU IP market to reach approximately $2.8 billion by 2025, with chip shipments increasing by 50% annually between 2024 and 2030, reaching over 21 billion chips by 2031, largely credited to its increasing use in Edge AI deployments.

RISC-V’s rise signifies more than just a new chip architecture; it represents a fundamental shift in how AI hardware is designed, developed, and deployed, resonating with broader trends in the AI landscape.

Its open and modular nature aligns perfectly with the democratization of AI. By removing the financial and technical barriers of proprietary ISAs, RISC-V empowers a wider array of organizations, from academic researchers to startups, to access and innovate at the hardware level. This fosters a more inclusive and diverse environment for AI development, moving away from a few dominant players. This also supports the drive for specialized and custom hardware, a critical need in the current AI era where general-purpose architectures often fall short. RISC-V’s customizability allows for domain-specific accelerators and tailored instruction sets, crucial for optimizing the diverse and rapidly evolving workloads of AI.

The focus on energy efficiency for AI is another area where RISC-V shines. As AI demands ever-increasing computational power, the need for energy-efficient solutions becomes paramount. RISC-V AI accelerators are designed for minimal power consumption, making them ideal for the burgeoning edge AI market, including IoT devices, autonomous vehicles, and wearables. Furthermore, in an increasingly complex geopolitical landscape, RISC-V offers strategic independence for nations and companies seeking to reduce reliance on foreign chip design architectures and maintain sovereign control over critical AI infrastructure.

RISC-V’s impact on innovation and accessibility is profound. It lowers barriers to entry and enhances cost efficiency, making advanced AI development accessible to a wider array of organizations. It also reduces vendor lock-in and enhances flexibility, allowing companies to define their compute roadmap and innovate without permission, leading to faster and more adaptable development cycles. The architecture’s modularity and extensibility accelerate development and customization, enabling rapid iteration and optimization for new AI algorithms and models. This fosters a collaborative ecosystem, uniting global experts to define future AI solutions and advance an interoperable global standard.

Despite its advantages, RISC-V faces challenges. The software ecosystem maturity is still catching up to proprietary alternatives, with a need for more optimized compilers, development tools, and widespread application support. Projects like the RISC-V Software Ecosystem (RISE) are actively working to address this. The potential for fragmentation due to excessive non-standard extensions is a concern, though standardization efforts like the RVA23 profile are crucial for mitigation. Robust verification and validation processes are also critical to ensure reliability and security, especially as RISC-V moves into high-stakes applications.

The trajectory of RISC-V in AI draws parallels to significant past architectural shifts. It echoes ARM challenging x86’s dominance in mobile computing, providing a more power-efficient alternative that disrupted an established market. Similarly, RISC-V is poised to do the same for low-power, edge computing, and increasingly for high-performance AI. Its role in enabling specialized AI accelerators also mirrors the pivotal role GPUs played in accelerating AI/ML tasks, moving beyond general-purpose CPUs to hardware optimized for parallelizable computations. This shift reflects a broader trend where future AI breakthroughs will be significantly driven by specialized hardware innovation, not just software. Finally, RISC-V represents a strategic shift towards open standards in hardware, mirroring the impact of open-source software and fundamentally reshaping the landscape of AI development.

The future for RISC-V in AI hardware is dynamic and promising, marked by rapid advancements and growing expert confidence.

In the near-term (2025-2026), we can expect continued development of specialized Edge AI chips, with companies actively releasing and enhancing open-source hardware platforms designed for efficient, low-power AI at the edge, integrating AI accelerators natively. The RISC-V Vector Extension (RVV) will see further enhancements, providing flexible SIMD-style parallelism crucial for matrix multiplication, convolutions, and attention kernels in neural networks. High-performance cores like Andes Technology’s AX66 and Cuzco processors are pushing RISC-V into higher-end AI applications, with Cuzco expected to be available to customers by Q4 2025. The focus on hardware-software co-design will intensify, ensuring AI-focused extensions reflect real workload needs and deliver end-to-end optimization.

Long-term (beyond 2026), RISC-V is poised to become a foundational technology for future AI systems, supporting next-generation AI systems with scalability for both performance and power-efficiency. Platforms are being designed with enhanced memory bandwidth, vector processing, and compute capabilities to enable the efficient execution of large AI models, including Transformers and Large Language Models (LLMs). There will likely be deeper integration with neuromorphic hardware, enabling seamless execution of event-driven neural computations. Experts predict RISC-V will emerge as a top Instruction Set Architecture (ISA), particularly in AI and embedded market segments, due to its power efficiency, scalability, and customizability. Omdia projects RISC-V-based chip shipments to increase by 50% annually between 2024 and 2030, reaching 17 billion chips shipped in 2030, with a market share of almost 25%.

Potential applications and use cases on the horizon are vast, spanning Edge AI (autonomous robotics, smart sensors, wearables), Data Centers (high-performance AI accelerators, LLM inference, cloud-based AI-as-a-Service), Automotive (ADAS, computer vision), Computational Neuroscience, Cryptography and Codecs, and even Personal/Work Devices like PCs, laptops, and smartphones.

However, challenges remain. The software ecosystem maturity requires continuous effort to develop consistent standards, comprehensive debugging tools, and a wider range of optimized software support. While IP availability is growing, there’s a need for a broader range of readily available, optimized Intellectual Property (IP) blocks specifically for AI tasks. Significant investment is still required for the continuous development of both hardware and a robust software ecosystem. Addressing security concerns related to its open standard nature and potential geopolitical implications will also be crucial.

Expert predictions as of November 2025 are overwhelmingly positive. RISC-V is seen as a “democratizing force” in AI hardware, fostering experimentation and cost-effective deployment. Analysts like Richard Wawrzyniak of SHD Group emphasize that AI applications are a significant “tailwind” driving RISC-V adoption. NVIDIA’s endorsement and commitment to porting its CUDA AI acceleration stack to the RVA23 profile validate RISC-V’s importance for mainstream AI applications. Experts project performance parity between high-end Arm and RISC-V CPU cores by the end of 2026, signaling a shift towards accelerated AI compute solutions driven by customization and extensibility.

The RISC-V architecture is undeniably a pivotal force in the evolution of AI hardware, offering an open-source alternative that is democratizing design, accelerating innovation, and profoundly reshaping the competitive landscape. Its open, royalty-free nature, coupled with unparalleled customizability and a growing ecosystem, positions it as a critical enabler for the next generation of AI systems.

The key takeaways underscore RISC-V’s transformative potential: its modular design enables precise tailoring for AI workloads, driving cost-effectiveness and reducing vendor lock-in; advancements in vector extensions and high-performance cores are rapidly achieving parity with proprietary architectures; and a maturing software ecosystem, bolstered by industry-wide collaboration and initiatives like RISE and RVA23, is cementing its viability.

This development marks a significant moment in AI history, akin to the open-source software movement’s impact on software development. It challenges the long-standing dominance of proprietary chip architectures, fostering a more inclusive and competitive environment where innovation can flourish from a diverse set of players. By enabling heterogeneous and domain-specific architectures, RISC-V ensures that hardware can evolve in lockstep with the rapidly changing demands of AI algorithms, from edge devices to advanced LLMs.

The long-term impact of RISC-V is poised to be profound, creating a more diverse and resilient semiconductor landscape, driving future AI paradigms through its extensibility, and reinforcing the broader open hardware movement. It promises a future of unprecedented innovation and broader access to advanced computing capabilities, fostering digital sovereignty and reducing geopolitical risks.

In the coming weeks and months, several key developments bear watching. Anticipate further product launches and benchmarks from new RISC-V processors, particularly in high-performance computing and data center applications, following events like the RISC-V Summit North America. The continued maturation of the software ecosystem, especially the integration of CUDA for RISC-V, will be crucial for enhancing software compatibility and developer experience. Keep an eye on specific AI hardware releases, such as DeepComputing’s upcoming 50 TOPS RISC-V AI PC, which will demonstrate real-world capabilities for local LLM execution. Finally, monitor the impact of RISC-V International’s global standardization efforts as an ISO/IEC JTC1 PAS Submitter, which will further accelerate its global deployment and foster international collaboration in projects like Europe’s DARE initiative. In essence, RISC-V is no longer a niche player; it is a full-fledged competitor in the semiconductor landscape, particularly within AI, promising a future of unprecedented innovation and broader access to advanced computing capabilities.

This content is intended for informational purposes only and represents analysis of current AI developments.

TokenRing AI delivers enterprise-grade solutions for multi-agent AI workflow orchestration, AI-powered development tools, and seamless remote collaboration platforms.

For more information, visit https://www.tokenring.ai/.

[ad_2]

RISC-V: The Open-Source Revolution Reshaping AI Hardware Innovation

[ad_1]

Keputusan Google untuk membuka akses terhadap chip AI terkuatnya, Ironwood, menandai momen penting dalam meningkatnya perlombaan senjata untuk supremasi kecerdasan buatan. Langkah strategis ini, yang disoroti oleh MacKenzie Sigalos dari CNBC dalam diskusi dengan Dom Chu, menggarisbawahi investasi Google selama satu dekade dalam perangkat keras berpemilik, menantang dominasi Nvidia dan mengintensifkan persaingan di antara penyedia cloud seperti Amazon dan Microsoft. Narasi yang mendasarinya adalah silikon khusus dengan cepat menjadi fondasi yang tidak dapat dinegosiasikan untuk inovasi AI yang terukur dan hemat biaya, yang secara mendasar mengubah lanskap kompetitif bagi para pendiri, VC, dan orang dalam di bidang teknologi.

Diskusi tersebut, yang ditampilkan di “The Exchange” CNBC, berpusat pada pengumuman Google mengenai chip AI internal terbarunya, dengan nama sandi “Ironwood.” MacKenzie Sigalos melaporkan bahwa chip ini, yang diperkenalkan pada bulan April dan sekarang tersedia untuk penjualan massal, dirancang untuk mendukung pemikiran canggih dan model AI inferensial, mewakili chip paling kuat dan hemat energi yang pernah dibuat Google. Perkembangan ini bukan hanya sekedar peningkatan teknologi secara bertahap; Ini adalah langkah yang diperhitungkan oleh Alphabet untuk memperkuat posisinya di sektor komputasi awan dan mendapatkan keunggulan signifikan di pasar AI yang sedang berkembang.

Wawasan inti yang muncul dari pengumuman ini adalah integrasi vertikal strategis Google. Dengan mengembangkan Tensor Processing Unit (TPU) miliknya sendiri, Google bertujuan untuk mengurangi ketergantungannya pada produsen chip eksternal, terutama Nvidia, dan mengoptimalkan perangkat kerasnya secara khusus untuk beban kerja AI yang menuntut. Pendekatan ini memungkinkan Google mencapai kinerja superior dan efisiensi energi untuk model AI miliknya, seperti Gemini, dan mitranya, termasuk Anthropic, yang berencana menggunakan hingga satu juta chip Ironwood untuk menjalankan model Claude-nya. Kemandirian ini diterjemahkan secara langsung ke dalam keunggulan biaya dan tingkat kontrol yang lebih besar terhadap infrastruktur AI-nya, sehingga memungkinkan Google untuk menawar lebih rendah dari pesaingnya untuk kontrak cloud besar.

CEO Google, Sundar Pichai, secara eksplisit memuji chip khusus ini karena telah mendorong pertumbuhan substansial dalam bisnis cloud perusahaan, dengan menyatakan, “Ini adalah salah satu pendorong utama pertumbuhan kami selama setahun terakhir, dan menurut saya di masa depan, kami terus melihat permintaan yang sangat kuat, dan kami berinvestasi untuk memenuhinya.” Komitmen ini terlihat dari belanja modal Google, yang diproyeksikan mencapai $93 miliar pada tahun ini, dengan peningkatan lebih lanjut diperkirakan terjadi pada tahun 2026, yang sebagian besar ditujukan untuk pengembangan dan penerapan chip. Investasi besar-besaran ini menandakan keyakinan Google bahwa kepemilikan lapisan perangkat keras sangat penting bagi kepemimpinan AI dalam jangka panjang.

Perlombaan senjata chip AI dengan tegas bergerak menuju silikon khusus. Meskipun GPU Nvidia telah menjadi standar de facto untuk pelatihan dan inferensi AI, para hyperscaler semakin menyadari pentingnya merancang prosesor khusus mereka sendiri. Amazon dan Microsoft juga memiliki chip AI internal, dan bahkan OpenAI dilaporkan menginvestasikan miliaran dolar dengan Broadcom untuk merancang chipnya sendiri. Namun, analis seperti Stacy Rasgon dari Bernstein mencatat bahwa Google menonjol sebagai satu-satunya hyperscaler yang benar-benar menerapkan chip AI khusus dalam skala besar, yang menunjukkan bahwa para pesaingnya “masih tertinggal bertahun-tahun dan miliaran dolar.” Skala penerapan ini memberi Google keuntungan unik dalam menyempurnakan desain bersama perangkat keras-perangkat lunaknya, sehingga menghasilkan metrik kinerja per watt yang tak tertandingi.

Dinamika persaingan ini semakin diperumit oleh ketegangan geopolitik, khususnya antara Amerika Serikat dan Tiongkok. Nvidia, yang saat ini menjadi pemimpin pasar, menghadapi lingkungan regulasi yang kompleks. Chip H20 canggihnya, yang ditujukan untuk pasar Tiongkok, masih dalam ketidakpastian persetujuan ekspor dengan pemerintah AS. Yang lebih parah lagi, Beijing dilaporkan mewajibkan pusat data yang didukung negara untuk menggunakan chip AI dalam negeri, dan dalam beberapa kasus bahkan memaksa penghapusan perangkat keras asing. CEO Nvidia Jensen Huang, yang melunakkan pernyataan sebelumnya, mengeluarkan pernyataan yang mengklarifikasi posisinya mengenai kemampuan AI Tiongkok, dengan menegaskan, “Seperti yang sudah lama saya katakan, Tiongkok tertinggal nanodetik di belakang Amerika dalam hal AI. Sangat penting bagi Amerika untuk menang dengan menjadi yang terdepan dan memenangkan pengembang di seluruh dunia.” Penyesuaian ini mencerminkan tindakan yang harus dilakukan produsen chip di tengah meningkatnya pembatasan perdagangan dan kekhawatiran keamanan nasional.

Dampak dari pembatasan ini sangat terasa bagi Nvidia, dengan laporan yang menunjukkan bahwa pangsa pasarnya di Tiongkok anjlok hingga nol di segmen tertentu. Kegagalan pembicaraan bilateral baru-baru ini antara Presiden AS Biden dan Presiden Tiongkok Xi Jinping untuk menghasilkan kemajuan dalam kebijakan chip semakin memperburuk ketidakpastian ini. Kesulitan yang dihadapi Nvidia menggarisbawahi sebuah wawasan penting: pasar chip AI global tidak hanya didorong oleh kecanggihan teknologi tetapi sangat dipengaruhi oleh kebijakan pemerintah dan hubungan internasional. Hal ini menimbulkan risiko bagi pelaku usaha yang sudah mapan dan peluang bagi pelaku usaha yang memiliki strategi terintegrasi secara vertikal dan rantai pasok yang terdiversifikasi.

Oleh karena itu, inisiatif Ironwood Google mewakili lebih dari sekedar produk baru; itu adalah pernyataan niat. Dengan menawarkan TPU canggihnya kepada pelanggan eksternal, Google tidak hanya memperkuat ekosistem cloud-nya tetapi juga menantang fondasi dominasi pasar Nvidia. Langkah ini menandakan masa depan di mana kemampuan merancang, memproduksi, dan menerapkan silikon AI khusus akan menjadi pembeda penting, yang menentukan nasib raksasa teknologi dan arah industri AI yang lebih luas.

[ad_2]

Chip Ironwood Google Membentuk Kembali Pertarungan Perangkat Keras AI

[ad_1]

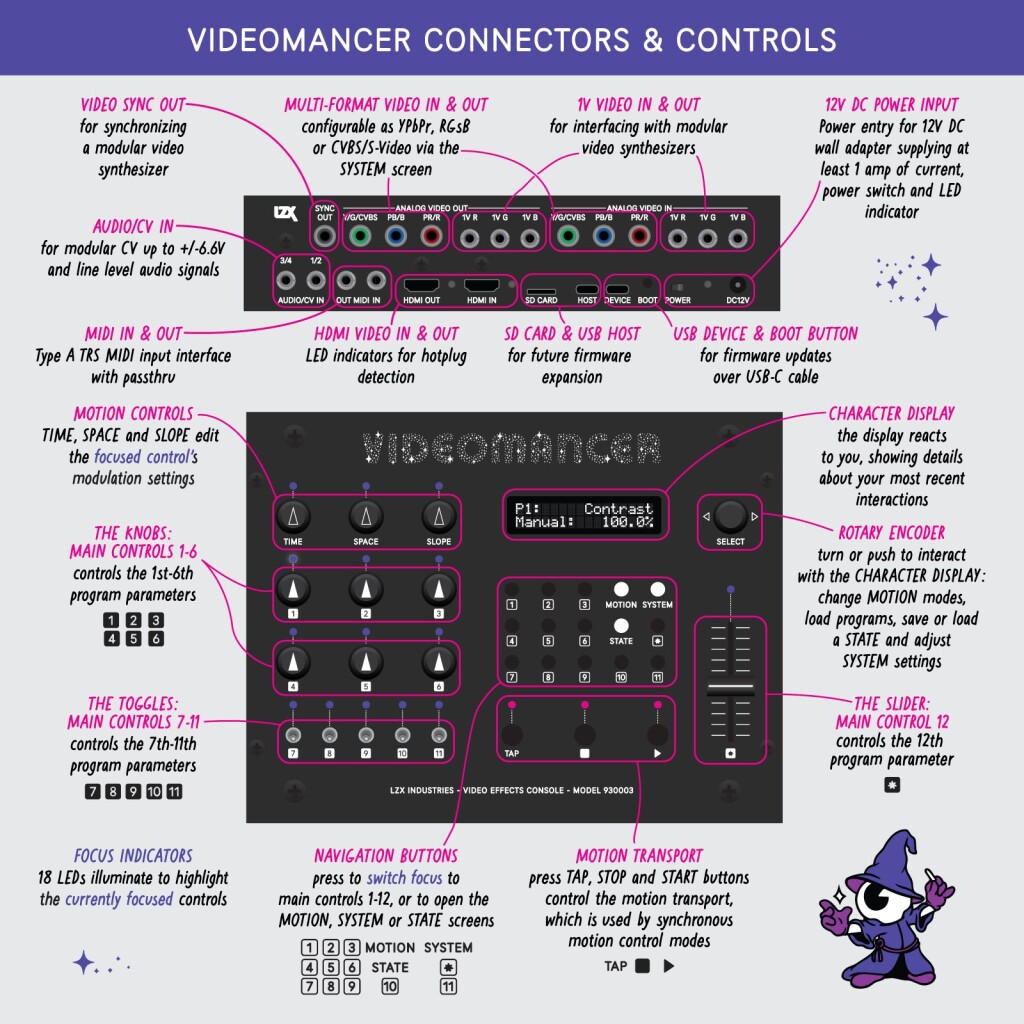

Edirol (Roland) V4. Peserta Korg. Anak-anak, sebagai… eh bibi dan paman VJ yang aneh. Namun ada suatu masa ketika perangkat keras video menjadi hebat. Dan rumah video Eurorack yang perkasa, LZX Industries, kembali bermain. Videomancer kelihatannya enak.

LZX tampaknya meningkatkan produksi di seluruh bisnisnya, dan hal ini sangat bagus untuk dilihat. (Ini bukan masa yang mudah bagi siapa pun di bidang perangkat keras, karena berbagai alasan.) LZX telah lama menjadi merek yang melakukan apa yang hanya dilakukan segelintir orang: membuat modul Eurorack dibangun berdasarkan video, bukan suara. Mereka membuat sistem lengkap yang mengesankan untuk pekerjaan itu, Double Vision. Dan ada satu modul yang mengubah tegangan Eurorack menjadi sinyal video, ESG3. Tapi Videomancer-lah yang menarik perhatianku. Halloween menghadirkan teaser baru:

Ini adalah sistem FPGA, yang membawa saya kembali lebih dari satu dekade ke unit efek FPGA Milkymist — yang tampaknya hidup online.

Videomancer adalah perangkat baru, dengan harga $999, dengan pemrosesan efek analog dan digital. Siap untuk format apa pun — NTSC, PAL, 240p, 288p, 480p, 576p, 720p50/59.94/60, 1080i50/59.94/60, dan 1080p23.98/24/25/29.97/30. (Whoa.) Dan ia menjanjikan “pemrosesan tingkat profesional untuk program glitch, noise, dan pengurangan bit yang merusak.”

Mungkin cara termudah untuk memahaminya adalah dengan memeriksa halaman pertama dari panduan singkatnya. Ini memiliki semua yang Anda inginkan. Yang Anda butuhkan hanyalah perangkat untuk menyalurkannya, baik itu Eurorack atau komputer atau perangkat genggam atau sumber video analog atau apa pun yang Anda bayangkan.

saya tertarik. Saya pasti akan membeli ini sebelum setengah CDJ.

https://lzxindustries.net/products/videomancer

[ad_2]

Videomancer LZX dapat membuat Anda bersemangat lagi tentang perangkat keras video FX

[ad_1]

Perusahaan perangkat lunak AS, SAS Institute, telah menarik diri dari pasar Tiongkok. Dengan langkah ini, perusahaan telah mengakhiri operasinya selama lebih dari dua dekade di tengah persaingan domestik dan ketegangan geopolitik. Menurut laporan South China Morning Post (SCMP), spesialis analisis tersebut juga menghilangkan sekitar 400 pekerjaan di Tiongkok daratan, kata seorang karyawan yang terkena dampaknya. Perusahaan dilaporkan mengumumkan PHK melalui email dan panggilan video singkat, yang dikutip oleh para eksekutif “optimasi organisasi” sebagai alasan keluarnya. Setiap karyawan yang terkena dampak diminta untuk menandatangani perjanjian pemisahan paling lambat tanggal 14 November.Paket kompensasi yang ditawarkan mencakup gaji satu bulan untuk setiap tahun masa kerja, gaji tambahan dua bulan, bonus tahunan, dan pembayaran hingga akhir tahun ini. Laporan tersebut mengutip seorang karyawan yang terkena dampak yang mengklaim bahwa SAS diperkirakan akan mengeluarkan pernyataan publik minggu depan. Situs web perusahaan yang disederhanakan dalam bahasa Cina dan lowongan pekerjaan di daratan tidak lagi online.

Dalam sebuah pernyataan kepada SCMP, juru bicara SAS mengatakan: “SAS menghentikan operasi bisnis langsung di Tiongkok. Keputusan ini mencerminkan perubahan yang lebih luas dalam cara kami beroperasi secara global, mengoptimalkan jejak kami, dan memastikan keberlanjutan jangka panjang.”Namun, juru bicaranya mengatakan perusahaan akan mempertahankan kehadirannya di negara tersebut melalui mitra pihak ketiga.Berbasis di Cary, Carolina Utara, SAS memasuki Tiongkok pada tahun 1999 dan mendirikan pusat penelitian dan pengembangan serta fasilitas dukungan pengguna di Beijing pada tahun 2005. Perusahaan ini dinobatkan sebagai perusahaan terbesar di Tiongkok daratan. “majikan teratas” selama 17 tahun berturut-turut oleh peneliti Belanda Top Employers Institute atas tunjangan karyawan dan budaya tempat kerja.“Perangkat lunak kami menjawab pertanyaan bisnis strategis yang tidak dapat dilakukan oleh orang lain – memungkinkan Anda mengendalikan biaya, meningkatkan pendapatan, mencapai efisiensi modal, dan memimpin dengan percaya diri,” Kata salah satu pendiri dan CEO SAS Institute James Goodnight saat berkunjung ke Hong Kong pada Mei 2001.Menurut laporan tersebut, cabang SAS di distrik Xuhui Shanghai sebagian besar tampak kosong, dengan hanya beberapa karyawan yang hadir ketika Post berkunjung sekitar tengah hari pada hari Jumat. Perabotan kantor dan tanaman tetap di tempatnya, dan area resepsionis masih terlihat a “Perusahaan Teratas di Tiongkok pada tahun 2021” plak.SAS memiliki dua entitas terdaftar di Guangzhou, provinsi Guangdong, untuk operasinya di Tiongkok selatan. SAS Software (Beijing) Co., Cabang Guangzhou, mengakhiri sewa kantornya dua bulan lalu. Pada saat yang sama, SAS Software (Shanghai) Co, Cabang Guangzhou belum beroperasi di alamat terdaftarnya setidaknya selama satu dekade, tambah laporan itu.Selain SAS, beberapa perusahaan teknologi AS lainnya telah mengurangi kehadirannya atau menarik diri dari negara dengan perekonomian terbesar kedua di dunia tersebut.Pada bulan September, pembuat komputer AS Dell Technologies memangkas pekerjaan di unit penyimpanan EMC dan Grup Solusi Klien di Shanghai dan Xiamen, provinsi Fujian. Hal ini terjadi setelah pembuat chip AS, Micron Technology, mengumumkan PHK lebih lanjut sebagai bagian dari restrukturisasi global menyusul lemahnya permintaan di pasar memori NAND seluler.Awal tahun ini, IBM menutup salah satu entitas lokal utamanya, IBM (China) Investment Co., yang mengakhiri 32 tahun operasinya. Penutupan ini terjadi setelah PHK tahun lalu terhadap lebih dari 1.000 karyawan di IBM China Development Lab dan China Systems Lab di beberapa kota.

[ad_1]

Chicago, 6 November 2025 /PRNewswire/ — SPLICE software dan Solvrays hari ini mengumumkan kemitraan strategis yang menghubungkan komunikasi tingkat perusahaan dengan otomatisasi alur kerja agen untuk membantu perusahaan asuransi menyederhanakan operasi, mempersonalisasi jangkauan, dan mengukur kinerja dengan kecerdasan waktu nyata.

Kolaborasi ini—diluncurkan secara langsung dari InsureTech Connect 2025 di Las Vegas—menyatukan Platform komunikasi omnichannel SPLICE Dan Mesin otomasi agen Solvraysmemungkinkan operator Property & Casualty (P&C) dan Life & Annuities (L&A) untuk beralih dari komunikasi ke tindakan terkoordinasi dengan lancar.

“Menggabungkan suara AI dan teks SPLICE dengan otomatisasi alur kerja agen Solvrays memberi perusahaan asuransi visibilitas dan kecepatan yang selama ini mereka lewatkan,” kata Tara KellyPresiden & CEO Perangkat Lunak SPLICE.

“Kini operator dan TPA dapat mengotomatiskan keseluruhan proses—mulai dari penjangkauan hingga wawasan—dengan dampak yang terukur,” tambah Bobbie SrivastavaSalah satu Pendiri & CEO Solvrays.

Mendorong Hasil Terukur di Seluruh Lini Asuransi

Untuk operator P&C: berakselerasi mengklaim komunikasi siklus hidup, retensi pemegang polisDan penjangkauan tanggap bencanameningkatkan waktu penyelesaian dan kepuasan.

Untuk penyedia L&A: mendukung personalisasi orientasi kebijakan, pembaruan penerima manfaatDan pencegahan kesalahan program untuk keterlibatan dan kepatuhan yang lebih kuat.

Untuk TPA dan mitra perusahaan: menyediakan dasbor terpadu yang mengungkapkan kemacetan alur kerja, kinerja agenDan sentimen pelanggan dalam waktu nyata.

“Kemampuan untuk secara instan mengubah percakapan teks dan suara omnichannel menjadi data terstruktur memberikan bahan bakar yang mendukung AI, memberikan kecepatan dan kedekatan yang diharapkan pelanggan, dengan efisiensi dan presisi yang dibutuhkan oleh operator, MGA, dan TPA.”

Meredith Barnes-Cook

Kepala Sekolah Senior, Praktik Asuransi – Datos Insights

Skala, Keamanan & Kecepatan Tingkat Perusahaan

Solusi terintegrasi ini dibangun untuk ekosistem operator yang kompleks, mendukung komunikasi multi-saluran suara, teks, obrolan, dan emailterhubung secara mulus ke lingkungan otomatisasi dan analitik agen Solvrays.

Tentang Perangkat Lunak SPLICE

Perangkat Lunak SPLICE memberdayakan perusahaan dengan komunikasi terintegrasi berbasis data yang menghubungkan merek dengan pelanggan melalui suara, teks, obrolan, dan email dalam skala besar. Solusinya dipercaya oleh perusahaan asuransi, lembaga keuangan, dan pengecer terkemuka untuk memberikan keterlibatan yang patuh, terpersonalisasi, dan terukur.

www.SPLICEsoftware.com

Tentang Solvray

Solvray adalah platform otomatisasi alur kerja agen dibangun khusus untuk operasi asuransi. Ini menggabungkan agen AI otonom, orkestrasi alur kerja tanpa kode, dan integrasi sistem lama untuk mengubah proses back-office manual menjadi alur operasional end-to-end yang real-time.

www.solvrays.com

[ad_1]

[ad_1]

Kredit: Universitas Negeri Idaho

Beberapa model yang digunakan untuk meramalkan segala sesuatu mulai dari tren keuangan hingga populasi hewan dalam suatu ekosistem tidak benar, menurut ahli statistik Idaho State University.

Dalam makalah baru yang diterbitkan di PLOS SatuJesse Wheeler, asisten profesor di departemen matematika dan statistik di Idaho State University, dan rekan penulisnya, Edward Ionides, profesor statistik di University of Michigan, berpendapat bahwa algoritme yang mendukung model rata-rata bergerak terintegrasi autoregresif (ARIMA) di dua lingkungan perangkat lunak umum menghasilkan perkiraan parameter yang tidak terlalu akurat. Dalam statistik, estimasi parameter adalah estimasi yang menggunakan data sampel yang dikumpulkan untuk membuat kesimpulan tentang suatu populasi.

“Ini seperti memiliki kalkulator yang mengklaim dapat menjumlahkan dua tambah dua dengan benar, namun terkadang memberikan jawaban yang salah, seperti dua tambah dua sama dengan tiga,” jelas Wheeler, pakar statistik dan komputasi. “Kita sering mengandalkan perangkat lunak statistik seperti yang kita lakukan pada kalkulator, jadi, jika kalkulator memberi tahu Anda bahwa ia memberi Anda perkiraan parameter tertentu, lebih baik melakukannya dengan keyakinan yang sangat tinggi.”

Model ARIMA termasuk yang paling umum digunakan untuk menganalisis data yang dikumpulkan dari waktu ke waktu. Mereka digunakan untuk menghubungkan nilai sesuatu saat ini – katakanlah, harga telur atau jumlah beruang yang hidup di suatu bagian hutan – dengan nilai masa lalu pada pengukuran yang sama. Hal ini memungkinkan peneliti memperhitungkan pola dan tren dalam data historis, membantu memfasilitasi penemuan ilmiah dan memperkirakan nilai masa depan.

“Model ARIMA biasanya merupakan model rangkaian waktu pertama yang dipelajari siswa di ruang kelas,” kata Wheeler. “Mereka diajarkan tidak hanya pada mata kuliah statistika, namun juga pada mata kuliah dari disiplin ilmu lain karena sangat berguna. Model ARIMA juga biasanya menjadi perbandingan dasar ketika mengembangkan algoritma statistik dan pembelajaran mesin baru.”

Selama penelitian Wheeler dan Ionides terhadap perangkat lunak yang digunakan untuk model ARIMA, mereka menemukan dan memperbaiki potensi masalah pengoptimalan dalam algoritme estimasi kemungkinan maksimum – algoritme yang menggunakan data sampel agar sesuai dengan model statistik – yang digunakan oleh perangkat lunak yang akan menghasilkan estimasi parameter suboptimal. Pada gilirannya, kata Wheeler, estimasi parameter di bawah standar dapat memengaruhi keakuratan perkiraan dan analisis statistik lainnya yang bergantung pada nilai parameter yang akurat.

“Sebagian besar praktisi bahkan tidak menyadari adanya masalah ini. Kami menemukan bahwa perkiraan kemungkinan maksimum perangkat lunak tidak sepenuhnya dioptimalkan, sehingga menghasilkan perkiraan parameter yang tidak dapat diandalkan,” kata Wheeler. “Algoritme yang digunakan mengklaim dapat memaksimalkan kemungkinan model, namun gagal melakukannya dalam sejumlah besar kasus – hingga 60% – bergantung pada data dan model.”

Selain menunjukkan kesalahan, para peneliti mengusulkan algoritma baru untuk mengatasi masalah tersebut dan menunjukkan bahwa algoritma tersebut berfungsi di R.

“Model ARIMA digunakan setiap hari oleh para peneliti dan profesional industri untuk peramalan dan analisis ilmiah di banyak bidang—ekonomi, layanan kesehatan, cuaca, dan banyak lagi,” kata Wheeler.

“Jika perangkat lunak yang memperkirakan model ini memiliki kekurangan, hal ini berpotensi menghasilkan hasil yang tidak diharapkan atau keputusan yang salah. Dengan mengidentifikasi dan memperbaiki masalah ini dalam pendekatan kemungkinan maksimum, penelitian ini membantu memastikan bahwa praktisi dan peneliti dapat mengandalkan hasil tersebut, yang pada akhirnya meningkatkan pengambilan keputusan dan pemahaman ilmiah. Bahkan peningkatan bertahap dalam akurasi estimasi dapat memberikan dampak nyata yang signifikan.”

Informasi lebih lanjut:

Jesse Wheeler dkk, Meninjau kembali inferensi untuk model ARMA: Peningkatan kesesuaian dan interval kepercayaan yang unggul, PLOS Satu (2025). DOI: 10.1371/jurnal.pone.0333993

Disediakan oleh Universitas Negeri Idaho

Kutipan: Perilaku yang tidak sesuai model: Perangkat lunak populer mungkin memberikan perkiraan yang salah (2025, 6 November) diambil 6 November 2025 dari https://phys.org/news/2025-11-behavior-popular-software-tools-faulty.html

Dokumen ini memiliki hak cipta. Terlepas dari transaksi wajar untuk tujuan studi atau penelitian pribadi, tidak ada bagian yang boleh direproduksi tanpa izin tertulis. Konten disediakan untuk tujuan informasi saja.

[ad_2]

Perangkat lunak populer mungkin memberikan perkiraan yang salah

[ad_1]

[ad_1]

Salah satu pertanyaan paling mendesak terkait Galaxy S26 Ultra adalah apakah Samsung akhirnya akan menawarkan beberapa peningkatan kamera yang nyata. Dan kami baru saja mendapat kabar baik dan buruk tentang kapal baru ini.

Mengatakan bahwa peningkatan kamera pada seri Ultra masih kurang di masa lalu tentu saja wajar. Sayangnya, postingan terbaru di X dari pengguna @chunvn8888 menunjukkan bahwa Galaxy S26 Ultra mungkin melanjutkan tren ini. Menurut postingan tersebut, bocoran firmware menunjukkan bahwa Samsung akan terus menggunakan banyak sensor yang sama seperti yang digunakan pada Galaxy S25 Ultra.

Detail debug sensor Galaxy S26 Ultra:200MP HP250MP JN3 ultrawide12MP S5K3LD 3x tele50MP IMX854 peris 5x12MP IMX874 selfieSatu-satunya perubahan kali ini adalah sensor ukuran tradisional 10MP 3x 1/1.39 digantikan oleh K3LD 12MP yang lebih baru. Sisanya sama persis dengan 25U6 November 2025

Namun, tampaknya Samsung dapat meningkatkan lensa telefoto 3x di ponselnya dengan sensor 12MP S5K3LD yang lebih baru. Meskipun hal ini memungkinkan peningkatan kualitas, perlu dicatat bahwa sensor S5K3LD memiliki ukuran yang sama dengan sensor 10MP yang disertakan dalam Galaxy S25 Ultra. Oleh karena itu, perbedaannya mungkin tidak terlalu drastis.

Sisi positifnya, keterangan rahasia IceUniverse baru-baru ini membocorkan bahwa Samsung mungkin menyertakan a aperture lebih besar pada kamera utama 200MP. Ini dapat membantu meningkatkan kualitas gambar dibandingkan model lama dengan memungkinkan lebih banyak cahaya masuk ke sensor. Namun, Samsung dikabarkan memiliki cara lain untuk meningkatkan gambar dari ponselnya.

media=”https://cdn.mos.cms.futurecdn.net/CYqGNENNRFyhLe6tGpCM4S.jpg”/>

media=”https://cdn.mos.cms.futurecdn.net/CYqGNENNRFyhLe6tGpCM4S.jpg”/>

Meskipun perangkat keras untuk kamera mungkin tidak berubah secara signifikan, Chip Samsung Exynos 2600 dapat memberikan dampak besar pada kinerja kamera. Informasi ini berasal dari postingan di X dari pengguna @SPYGO19726, yang mengklaim sumbernya berasal dari dokumentasi internal dan percakapan dengan para insinyur.

Sensor Maks 320 MP (tunggal) / 108 MP triple-streamHDR Engine 5-frame fusion, 14-bit RAW pipeline Multi-Sensor Hingga 4 sensor bersamaanVideo 8K 60 fps HDR10+ / 4K 120 fps Burst Mode 30 fps @ 108 MP RAWISP-NPU Bandwidth Perkiraan throughput internal 1,8 TB/s https://t.co/WIiJPzBLYH5 November 2025

Diduga, prosesor sinyal gambar Exynos 2600 akan mampu menangani satu kamera utama 320MP atau tiga kamera 108MP secara bersamaan. Selain itu, chip tersebut juga diperkirakan memiliki fitur mesin HDR yang mampu menggabungkan lima frame sekaligus, sekaligus mampu memproses gambar RAW 14-bit.

Namun, belum ada indikasi Galaxy S26 Ultra akan mengusung kamera utama 320MP. Sebaliknya, chip ini dapat meningkatkan kinerja secara signifikan dalam kondisi cahaya rendah, dengan gambar menawarkan peningkatan kualitas dan akurasi warna yang lebih baik.

Chip ini juga menawarkan beberapa peningkatan untuk perekaman video, karena diklaim mampu merekam 8K dengan dukungan HDR10+ pada 60fps, serta 4K pada 120fps. Tak hanya itu, chip tersebut kabarnya juga menggunakan stabilisasi gambar optik dan stabilisasi gambar elektronik berbasis AI.

Terakhir, Exynos 2600 dapat membantu meningkatkan efisiensi daya, dengan bocoran yang mengklaim bahwa ISP chip tersebut menggunakan daya 30% lebih sedikit dibandingkan Exynos 2400 yang lebih lama. Mengingat Galaxy S25 Ultra mendapat tempat di daftar masa pakai baterai ponsel terbaik kami, ini bisa menjadi perubahan besar pada masa pakai baterai secara keseluruhan.

Perlu diingat bahwa Galaxy S26 Ultra versi AS diperkirakan akan menampilkan chip Snapdragon 8 Elite Gen 5, meskipun menjanjikan beberapa peningkatan tersendiri.

Seperti halnya bocoran atau rumor lainnya, kami tidak dapat memastikan apa pun sampai kami memiliki kesempatan untuk menguji sendiri ponsel tersebut. Sayangnya, kita mungkin harus menunggu lebih lama untuk mendapatkan kesempatan tersebut, karena acara Samsung Galaxy Unpacked dikabarkan akan berlangsung pada akhir Februari, yang berarti seri Galaxy S26 kemungkinan besar baru akan tersedia pada pertengahan Maret.

Sampai saat itu tiba, beri tahu kami pendapat Anda tentang rumor peningkatan Galaxy S26 Ultra dan apa yang ingin Anda lihat.

Mengikuti Panduan Tom di Google Berita Dan tambahkan kami sebagai sumber pilihan untuk mendapatkan berita, analisis, dan ulasan terkini di feed Anda.